Planetenfotografie mit der CCD/CMOS-Kamera: Aufnahme

Die Digitalfotografie bietet unglaubliche Möglichkeiten. Sternfreunde machen heute Fotos, wie sie vor einigen Jahrzehnten nur Profis mit äußerst leistungsfähigen Teleskopen möglich waren. Ihre Planetenfotos zeigen dank der Technik des Lucky Imaging wesentlich mehr Einzelheiten, als sie das menschliche Auges am selben Fernrohr erkennt. Und während die Sehkraft mit zunehmendem Lebensalter abnimmt, werden die digitalen Bildsensoren von Jahr zu Jahr feiner und lichtempfindlicher.

Eigentlich fotografiert man Planeten gar nicht - man filmt sie. Damit lassen sich bildverschlechternde Faktoren wie die Luftunruhe und das Rauschen des Kamerasensors zumindest mindern.

Vorbereitung sinnvoll

Astronomische Objekte fotografiert man nach Möglichkeit zum Zeitpunkt ihrer Kulmination, also ihres Höchststands im Süden. Den Zeitpunkt der Kulmination nennt unter anderem die ausgezeichnete und vielseitige Astro-Software Guide. Sie verrät Ihnen vieles mehr - etwa die Lage des Mondterminators, die Stellung der Jupiter- und Saturnmonde, die Sichtbarkeit des Großen Roten Flecks oder der Albedostrukturen auf Mars. Planetenfotografen setzen auch auf das kostenlose Programm Winjupos.

Bei niedrigem Stand wird die Bildqualität nämlich noch mehr von der Luftunruhe gemindert. Näheres zum wichtigen Thema Seeing lesen Sie hier. Anzustreben wären Seeing-Werte um 1 Bogensekunde.

Bei dieser Auflösung trennte man Details mit 3.000 km in Jupiter- bzw. 6.000 km in Saturnentfernung. Bei der günstigsten Mars-Opposition käme man theoretisch auf 370 km. Bei hohem Kontrast können Amateurteleskope auch noch kleinere Einzelheiten sichtbar machen: Die bekannte Cassini-Teilung im Saturnringsystem ist z.B. bloß 4.800 km breit.

Die Form von Fernrohrspiegeln ist temperaturabhängig. Schmidt-Cassegrains (SCs), aber auch Maksutov- und Newton-Teleskope müssen daher vor dem Einsatz an die Außentemperatur angepasst werden. Die Adaptionszeit hängt von der Bauweise und dem Temperaturunterschied ab. Ich stelle mein SC gern eineinhalb bis zwei Stunden vor dem Fotografieren auf den Balkon. Bei Linsenteleskopen tritt dieses Problem meiner Erinnerung nach nicht auf.

Hier herrscht einmal bestes Seeing: Links sehen Sie Fotos des Jupitermonds Ganymed, rechts den Vergleich mit Guide: Die Software macht klar, dass ich hier tatsächlich Oberflächendetails festgehalten habe.

Aufnahmegeräte

Als Kameras dienten früher gern preiswertere Webcams wie die z.B. Philips SPC 900NC (rechts). Es gibt aber auch die spezialisierte NexImage 5 (links) bzw. NexImage 10 von Celestron. Zur Steuerung existieren kostenlose Programme.

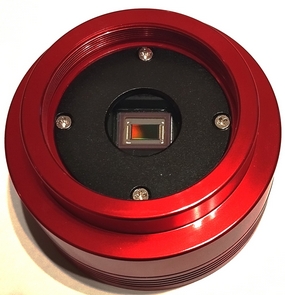

Besonders bekannt sind die Planetenkameras der Firma Zwo (Beispiel im Foto links). Manche, wie etwa meine Asi 678MC, sind nicht nur im visuellen Licht sehr empfindlich, sondern auch im IR.

Solche Cams werden anstatt des Okulars in den Okularauszug des Teleskops gesteckt bzw. geschraubt. In meinem Fall ist das ein LX90 von Meade.

Oversampling & Undersampling

Hier geht es darum, die ideale Sensor-Pixelgröße für ein bestehendes Teleskop zu finden. Oder darum, die reale Teleskopbrennweite durch den Einsatz einer Barlow-Linse an eine vorhandene Kamera anzupassen. Wer will, kann das einschlägige Formelwerk studieren. Eine vereinfachte Faustregel lautet so:

- Ideales Öffnungsverhältnis des Teleskops = 5 x Pixelgröße des Sensors

Bei einer Pixelgröße von 2,9 Mikrometern sollte das Öffnungsverhältnis demnach 14,5 betragen.

Barlow-Linsen verändern das Öffnungsverhältnis

Barlow-Linsen verlängern die Teleskopbrennweite und verändern somit das Öffnungsverhältnis. Mit ihrer Hilfe will man das sogenannte Undersampling vermeiden: Diese Unterabtastung tritt ein, falls das abgebildete Objekt zu wenige Sensorpixel überstreicht.

Auf Basis der oben erwähnten "5 x Regel" lässt sich der ideale Verlängerungsfaktor der Barlow-Linse berechnen:

- 5 x Pixelgröße (Mikrometer) * Objektivdurchmesser (mm) / Nennbrennweite (mm)

Beispiel: Beim Meade LX 90 beträgt der Durchmesser 200 mm, die Nennbrennweite 2.000 mm. Die Cam Asi 662 MC besitzt eine Pixelgröße von 2,9 Mikrometer. Nach der Fünferregel sollte das ideale Öffnungsverhältnis 14,5 betragen. Die ideale Brennweite wäre 2.900 mm, was eine Barlow-Linse mit 1,5 facher Vergrößerung erforderte.

Die Sache hat freilich einen Haken: Mit steigendem Abbildungsmaßstab sinkt auch die Lichtstärke des optischen Systems. Und das gleich quadratisch.

Bei einer linearen Vergrößerung ums Zweifache verteilt sich das Licht auf die vierfache Fläche. Man muss dann jedes Frame viermal so lange belichten - oder das Gain höher schrauben.

Im ersten Fall setzt man sich der Luftunruhe noch mehr aus und reduziert überdies die Zahl der erfassbaren Frames pro Sekunde (fps). Im zweiten Fall schlägt das Rauschen heftiger zu.

Barlow-Linsen (im Bild oben versammeln sich gleich vier von unterschiedlichen Herstellern) werden jedenfalls als negativ wirkende Linsenkombinationen erzeugt. Jede "Linse" besteht in Wahrheit aus 2 oder 3 Einzellinsen.

Das dreilinsige Design ist vorzuziehen: Eine solche apochromatische Barlow vermag das Licht dreier Wellenlängen gleichzeitig im selben Brennpunkt zu vereinen und wirkt somit am farbreinsten. Infrarotes Licht wird trotzdem weit abstreifen und das scharf gestellte Objekt mit einem unsichtbaren Saum umhüllen.

Filter gegen Lichtsäume und gegen die Luftunruhe

CCD/CMOS-Cams sind oft auch im Ultraviolett und Infrarot empfindlich. Das kann speziell bei Linsenfernrohren zu Problemen führen.

Aber auch bei Spiegelteleskopen, falls sich eine Barlow-Linse (s.o.) im Strahlengang befindet:

In solchen Fällen schraubt man ein UV/IR-Sperrfilter vor die Kamera. Es hält, ganz nebenbei, auch Staub vom Sensor fern.

Mit IR-empfindlichen Cams kann aber auch ganz bewusst im Infrarot selbst filmen, wobei z.B. die IR-Filter von Baader, Planet Pro 740 oder Zwo 850 zum Einsatz kommen.

Sie können die IR-Empfindlichkeit ihrer Kamera selbst prüfen, indem Sie mit einer IR-Fernbedienung (z.B. vom TV-Gerät) hinein leuchten und einen Knopf darauf drücken. Für unsere Augen bleibt die Leuchtdiode der Fernbedienung dunkel. Eine IR-empfindliche Kamera zeigt sie leuchtend. Mit der Smartphone-Cam gelingt dies wahrscheinlich, mit einer normalen DSLR nicht (da sitzt nämlich ein UVIR-Sperr-Filter fix vor dem Sensor).

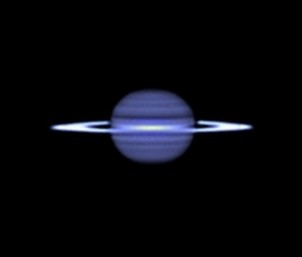

Im IR schauen die Gasplaneten dunkel aus. Ursache ist eine Prise Methan in deren Atmosphären: Es verschluckt IR-Licht. Noch dramatischer geriete der Effekt mit einem speziellen Methanbandfilter.

Saturn fotografiert mit der Asi 662MC und einem Zwo 850 IR-Filter

Falls die CMOS-Cam im IR empfindlich ist, kann man Experimente anstellen. Oben Jupiter am 16.12.2024: links im rein visuellen Bereich, in der Mitte im Visuellen plus IR und rechts nur im IR (etwa 740 bis knapp 1000 nm)

Zurück zum sichtbaren Licht: Um die Luftunruhe zu reduzieren, mag man ein Rotfilter (z.B. Nr. 25) oder das Baader Long-Pass 610 verwenden. Dann sind zwar die originalen Farben weg - bei Mond, Merkur oder Venus ist das aber egal: Bei Aufnahmen in der farbigen Dämmerung steigert das rote Glas zudem den Kontrast, weil es das Himmelsblau mindert.

Aber Achtung: Filter sind meist für den visuellen Einsatz konzipiert: Diese lecken fast immer im Infrarot. Ein Violettfilter lässt z.B. tiefblaues Licht passieren, aber noch mehr infrarotes. Das resultierende Bild ist dann primär im IR entstanden.

Weiteres zum Einsatz von Filtern bei der visuellen Beobachtung und in der Fotografie lesen Sie hier.

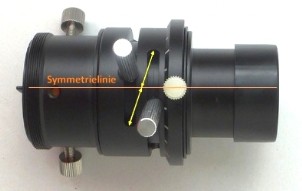

Zentrieren

Bei einem größeren Kamerasensor (z.B. 3840 x 2160) sollte schon ein korrekt justiertes Sucherfernrohr reichen, um den damit anvisierten Planeten zumindest irgendwo im maximal aufgezogenen Bildfeld abzubilden. Mit den Feinbewegungen holt man diesen dann in die Mitte.

Bei kleinflächigen Bildsensoren landet das Objekt aber oft zunächst außerhalb des Feldes. Zum ersten Zentrieren leistet daher ein Fadenkreuzokular gute Dienste.

Fein ist auch ein arretierbarer Ring, der über die Steckhülse des Okulars passt. Einmal geeicht, liefert das Okular damit auch gleich eine grobe Fokussierung. Ein stark defokussiertes Objekt ist auf dem Monitor nämlich kaum zu erkennen.

Ausrichten

Das Nachführen auf den Planeten fällt leichter, falls die Sensorkanten genau so ausgerichtet sind wie die Teleskopbewegungen. Dazu muss die Oberseite der Cam in Richtung der Oberseite des Teleskoptubus' schauen. Eine kleine, aufgeklebte Markierung auf der Kamera erleichtert das.

Sollte nur der Planet im Bild sein, ist es unerheblich, wie dieser zu den Sensorkanten geneigt ist. Man kann das Summenbild später immer noch drehen. Bei der Venus erziele ich aber bessere Resultate, wenn sie schon beim Filmen wie ein aufrecht stehendes D auf dem Monitor erscheint - und nicht in "Schieflage".

Will man die Riesenplaneten hingegen mit mehreren ihrer Monde einfangen, reicht die Längsseite des Bildfelds vielleicht nicht aus. Dann wird man die Bilddiagonale ausnützen und die Cam entsprechend verdrehen.

Fokussieren

Vor der Aufnahme muss man peinlich genau scharfstellen. Man orientiert sich dabei zumeist an kleinen Details, die offenbar nur bei perfekter Scharfstellung sichtbar werden. Beim Saturn wird das z.B. die Cassini-Teilung sein, beim Jupiter sind es Einzelheiten in den Wolkenbändern. Beim Mars ist das Fokussieren gar nicht einfach. Überhaupt fällt es umso schwerer, je größer die Luftunruhe gerade ist.

Obwohl Bahtinov-Masken zum Scharfstellen punktförmiger Objekte ersonnen wurden, kann man es notfalls auch damit versuchen. Das resultierende Bild am Monitor wird bei Planeten zwar höchst ungewohnt aussehen, dennoch zeigen sich bei korrektem Fokus Symmetrien - nur eben nicht so klar und scharf wie bei Sternen. Besser man stellt mit dieser Notlösung scharf, als gar nicht.

Bleibt das Bild arm an Details, oder scheint das Scharfstellen unmöglich zu sein, überprüfen Sie die Kollimation Ihres Spiegelteleskops. Möglicherweise ist auch das Seeing unerwartet schlecht, die Luft also zu unruhig. Bei Meade-SC-Teleskopen ohne Spiegelarretierung beenden Sie das Fokussieren am besten mit einem letzten Dreh gegen den Uhrzeigersinn. Sonst kippt der Spiegel noch leichter.

Mit der Hand geht das Fokussieren schlecht, weil jede Erschütterung das Bild wanken lässt. Ein wackliges Bild kann man auf dem Computermonitor aber nicht auf seine Schärfe hin beurteilen. Ich empfehle daher elektrische Fokussierer.

Der nachträglich gekaufte Meade-Fokussiermotor erfüllt diesen Zweck. Er funktioniert analog und wird von einer speziellen Handbox aus gesteuert.

Ein analog-digital-Wandler erlaubt sogar den Anschluss ans Notebook bzw. den PC. Das ist wichtig, wenn man das Teleskop beim Fotografieren bzw. Filmen fernsteuern will.

Was ist "Lucky Imaging"?

Generell ist das Scharfstellen eine Kunst, weil das erwähnte Seeing die Bildschärfe in rascher Folge verändert. Es ist, als schöben sich in chaotischer Abfolge verschiedenste Brillengläser zwischen das Teleskop und den Planeten.Man wird somit bestenfalls einen Fokuspunkt finden, in dem das Bild häufig scharf erscheint. Knapp abseits dieses Punkts wird es seltener scharf.Je mehr Frames ein Video umfasst, desto größer die Chance auf ein paar Tausend scharfe Einzelbilder. Dieses Lucky Imaging war mit analogem Filmmaterial kaum denkbar. Es hat die Aufnahmetechnik revolutioniert.

Aufnahmeprogramme

Um die Cam zu steuern gibt es verschiedene Programme. Oft werden sie von den Kameraherstellern selbst entwickelt - wie z.B. das Asi Studio von Zwo oder ICap für die von Celestron verkauften NexImage-Cams.

Ich empfehle das kostenlose FireCapture von Thorsten Edelmann. Es kommt mit einer Vielzahl von Cams zurecht und kann sogar Teleskope steuern.

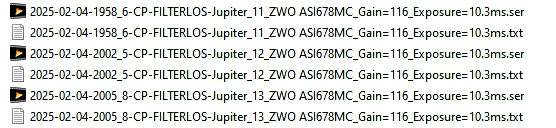

Die Software speichert Konfigurationen je nach Planet und Filterkombination ab, zeigt Ephemeriden an und stempelt optional eine laufende Zeitangabe in die Frames ein. Der Dateiname beinhaltet auf Wunsch alle wichtigen Fakten, inklusive Datum, Uhrzeit (UT), Objekt, Filter, Kameraname, Belichtungszeit und Gain.

Das jedem Video beigefügte Log-File hält diese Daten ebenso fest, mitsamt der genannten Ephemeriden und einer Zeitangabe pro Frame. Letzteres ist z.B. beim Filmen von Impakten oder Sternbedeckungen interessant.

Ungewohnt für Fotografen mag die Angabe der Belichtungszeit in Millisekunden anstatt der vertrauten Sekundenbruchteile sein: 1/60 sec sind demnach 16,7 ms; 100 ms wären 1/10 sec.

Zwei weitere Features helfen, falls die Nachführung des Fernrohrs nicht perfekt läuft:

So folgt die enge Region of Interest (ROI, siehe weiter unten) tatsächlich dem Planeten, indem Korrektursignale ans Teleskop geschickt werden. Damit bleibt dessen Abbild stets im Zentrum des Sensors. Bei mir funktioniert das nicht gescheit.

Alternativ folgt die ROI bloß virtuell dem Planeten, während sein Abbild langsam über den Sensor wandert. Zum Rand hin ändert sich zumeist leider die Fokusebene. Deshalb wird man jede Aufnahme in der Bildmitte starten. Während einer kürzeren Aufnahme oder einer kürzeren Serie mehrerer Aufnahmevorgänge braucht man danach aber nicht mehr auf den Monitor zu starren: Der Planet bleibt wie von Zauberhand in der ROI.

Man kann die Software auch anweisen, mittels Autorun-Funktion z.B. 30 jeweils dreiminütige Videos hintereinander anzufertigen, eventuell sogar mit Filterwechsel. Das Feature TimeLapse hilft bei der Anfertigung von Zeitraffervideos.

Trouble-Shooting-Tipp: Sollte die Kamera nach dem Anstecken nicht erkannt werden, versuchen Sie, den Rechner mit schon angeschlossener Cam hochzufahren.

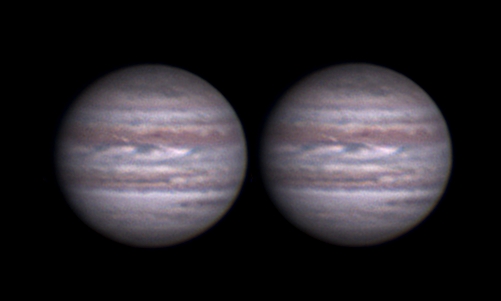

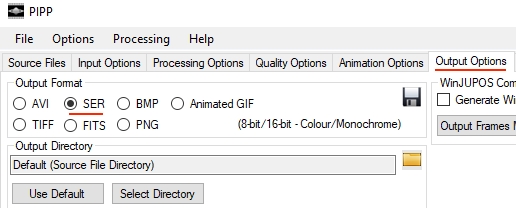

Eine Frage des Formats: SER oder AVI

Die meisten Mond- und Planetenfotografen ziehen das unkomprimierte Dateiformat SER dem Format AVI vor, wobei mir der Unterschied im fertigen Resultat gering scheint. Vergleichen Sie bitte die beiden Jupiterfotos, die unmittelbar nacheinander entstanden und exakt gleich entwickelt wurden. Was war SER, was AVI?

Jupiter am 17.2.2025 - links im SER-, rechts im AVI-Format aufgenommen

Programme wie Autostakkert oder DeTeCt kommen mit beiden Formaten zurecht. Der einzige Nachteil von SER: Missratene Passagen lassen sich mit VirtualDub zwar aus AVI-, nicht aber aus SER-Videos heraus schneiden. Notfalls müsste man SER-Videos zu diesem Zweck zunächst in AVI-Dateien umwandeln.

Das geht z.B. mit dem SER-Player. Aber auch mit PIPP: Dort stellt man in Output Options das Format AVI ein. Ansonsten sollte man in PIPP aufs Output Format SER achten, falls die Videos in diesem Format angefertigt wurden - sonst würden sie ja unbeabsichtigt in AVI-Dateien umgeformt.

Binning

Beim Binning werden jeweils mehrere benachbarte Pixel zusammengefasst. Das resultierende Bild wird heller, aber gleichzeitig sinkt die Auflösung. Mittels Binning konnte ich mit der Asi 678 MC am PC-Monitor sogar den Saturnmond Hyperion erahnen - trotz einer Helligkeit von nur 14,3 mag.

Gain

Die Software zur Kamerasteuerung gestattet es, das sogenannte Gain einzustellen - eine elektronische Vorverstärkung. Ein höheres Gain verstärkt das Bildrauschen, ist aber bei Objekten mit geringer Oberflächenhelligkeit (z.B. Saturn) unumgänglich. Dank des höheren Gain lässt sich kürzer belichten, was wiederum die Framerate (fps) steigert.

Belichtungszeit

Man strebt eine möglichst kurze Belichtungszeit an, um die Luftturbulenzen während jeder einzelnen Belichtung einzufrieren. Zumindest, wenn man kann:

Bestimmend beim hochauflösenden Fotografieren ist nämlich nicht die Gesamthelligkeit eines Objekts, ausgedrückt in mag, sondern dessen Helligkeit pro Flächeneinheit: Merkurs Oberfläche ist im Schnitt sechsmal heller als die des Vollmonds, die Venus strahlt 10 mal so hell wie der Mond. Beim Mars muss man von der Hälfte, beim Jupiter schon von einem Sechstel der Mondhelligkeit ausgehen. Beim Saturn ist es gar nur ein Zwanzigstel. Beim Uranus wäre es ein Achtzigstel, beim Neptun ein Zweihundertstel der Mondhelligkeit.

Mit erhöhtem Gain kann man dieses Problem nur zum Teil lösen. Daher wird man bei Planeten mit geringer Helligkeit entsprechend länger belichten müssen, was wiederum den Einfluss der Luftunruhe verschärft.

Gamma

Ein Verringern des Gamma-Werts kann beim Fokussieren helfen, um mehr Detail auf dem Monitor zu erkennen.

Bei der Aufnahme belässt man diesen Regler auf Mittenstellung (50%) oder passt ihn an das zu erfassende Objekt an: Beim Mond mit seinen starken Kontrasten wird der Gamma-Wert dann eher erhöht, bei Planeten mit ihren geringen Kontrasten eher verringert.

Im Gegenzug wird man den Gain-Regler neu anpassen müssen.

Frame-Rate

Davon anhängig ist die Frame-Rate, also die Anzahl der Einzelbelichtungen pro Sekunde (fps). Man strebt hier ebenfalls hohe Werte an. Die Frame-Rate ist aber immer geringer als die Belichtungszeit. Belichtet man 1/50 sec, wird man also kaum mehr als 40 Frames pro Sekunde schaffen (nach jeder Belichtung muss der CCD-Chip ausgelesen und das Ergebnis an den Computer übertragen werden; auch das dauert seine Zeit).

Frame-Anzahl bzw. Filmlänge

Die Bildqualität wird letztlich mit der Anzahl der gewonnenen Frames steigen. Es sollten mehrere tausend pro avi- bzw. ser-File sein. Bei den Planeten könnte man einige Minuten lang filmen, um möglichst viele Frames einzufahren.

Der planetaren Rotationen wegen verschmieren dabei allerdings die Details. Schauen wir uns die Situation bei den Oppositionen des Jahres 2018 an: Ist eine fotografische Auflösung von 1" am Jupiteräquator erwünscht, darf man hier laut meiner Rechnung maximal 4,3 Minuten lang filmen.

Sind Jupitermonde im Spiel, muss man sich ebenfalls sputen: Sie und ihre Schatten bewegen sich in Relation zum Planeten rasch.

Das Foto links zeigt zwei Monde und deren Schatten gleichzeitig

Beim Saturn sind es 13 und beim Mars 20 Minuten. Saturn ist allerdings ein Sonderfall. Nur radiale Details in den Ringen und vertikale Details auf der Planetenkugel können meiner Meinung wirklich verschmieren. Sind solche nicht zu erkennen (was meist der Fall sein wird), gilt das Zeitlimit - wie ich meine - nicht.

Bei Venus und Merkur gelten sowieso keine Grenzen - wegen der langsamen Rotation und der fehlenden Details. Das Problem tritt also vor allem beim Jupiter auf.

Mit zunehmendem zeitlichen Abstand zur Opposition bzw. mit steigendem Abstand zum Planetenäquator wird das Problem kleiner. Dann darf man auch länger filmen.

Mithilfe der Software WinJUPOS lassen sich Bilder und Videos nachträglich derotieren: Näheres dazu hier.

ROI - Region of Interest

Um die Dateigrößen einzuschränken und die erzielbare Frame-Rate zu erhöhen, zieht man ums Objekt gern eine sogenannte Region-of-Interest (ROI). Ein Beispiel für die Dateigröße: Saturn mit 408 x 348 Pixeln und 30 Frames pro Sekunde erfordert etwa 1 GB pro Minute Filmlänge. Filmt man für jedes Video 5 Minuten lang, so ist eine 30 GB große Festplattenpartition nach nur 6 avis voll.

Bei nicht optimaler Nachführung droht der Planet aber rasch aus der ROI heraus zu wandern.

Dann hält man die Aufnahme rechtzeitig mit der Pausetaste an, bringt das Objekt mittels der Teleskopsteuerung wieder in die Mitte und setzt das Recording fort.

Nötigenfalls kann man auch ohne Anhalten der Aufnahme korrigieren - möglichst selten und mit sehr langsamer Geschwindigkeit. Ich erziele damit allerdings nicht ganz so gute Ergebnisse wie mit der zuvor genannten Taktik.

Atmosphärische Dispersion beseitigen

Unsere Lufthülle wirkt wie ein Prisma: Sie bricht kurzwelliges Licht stärker als langwelliges. Daher erhalten alle Planeten unten einen roten, oben einen blauen Rand. Je weiter der Lichtweg durch die Atmosphäre, desto stärker wird der Effekt. Tiefstehende Objekte werden davon stärker geplagt als solche, die hoch droben am Himmel stehen.

Die atmosphärische Dispersion stört bei hochauflösenden Aufnahmen. Um das Problem zu mildern, gibt es mehrere Verfahren:

1. Idealerweise beseitigt man die Dispersion, bevor das Licht überhaupt den Kamerasensor erreicht.

2. Man versucht, störende Farbränder teilweise mit einem Farbfilter zu minimieren. Das führt freilich zu einer farblichen Veränderung des gesamten Bildeindrucks. Eventuell lohnen Versuche mit farbneutraleren kontraststeigernden Filtern (Fringe Killer, Contrast Booster, Semi-Apo-Filter).

3. Man verwendet nur einen der drei Farbkanäle des Videos zur Weiterverarbeitung. Das ist in etwa so, als hätte man ein blaues, grünes oder rotes Farbglas vor die Kamera gesetzt.

4. Man überlässt die Beseitigung der Farbprobleme der nachfolgenden Bildbearbeitung: Bei Autostakkert und Registax heißt die entsprechende Funktion RGB-Align. Das ist nicht der allerbeste, aber der mit Abstand bequemste Weg.

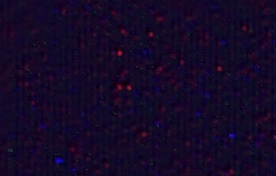

Darkframe nötig?

Bei den lichtschwachen Planeten Uranus oder Neptun sind längerere Belichtungszeiten und eine hohe Gain-Einstellung nötig. Da macht sich das Rauschen des Kamera-Sensors besonders stark bemerkbar. Hot Pixels treten auf.

In diesem Fall erstellt man ein zweites Video: Mit absolut gleichen Einstellungen - jetzt aber mit dem Objektivdeckel am Teleskop! Um auch die Temperatur gleich zu halten, sollte man es unmittelbar auf das eigentliche Planetenvideo folgen lassen. Die Länge der Aufnahme ist hier nicht entscheidend.

Dieses Video hält nur das Kamerarauschen, nicht aber das Himmelsobjekt fest. Es liefert uns letztlich ein sogenanntes "Darkframe" voller Artifakte. Zur Verdeutlichung wurde die Helligkeit hier überhöht.

Die nachfolgend vorgestellte Software kann ein solches Darkframe vom eigentlichen Objektfoto ("Lightframe" genannt) abziehen, und so das Rauschen großteils beseitigen. Deep Sky Fotografen sind Darkframes bestens vertraut. Denn sie arbeiten fast immer mit längeren Belichtungszeiten.

Mit Autostakkert geht das so: Man lade das absolut dunkle avi und wähle "Image Calibration", "Create Master Frame". Das Resultat wird als *.tif abgespeichert. Nun nimmt man das eigentliche Objektvideo, und wählt unter "Image Calibration" noch "Use Master Dark".

Zum Testen habe ich das Trapez im Orionnebel mit der Planetenkamera NexImage5 eingefangen - und das bei miserablem Seeing. Links ein Frame des unbehandelten Videos, rechts das Bild nach Abzug des Masterdarks (und mit RGB-Align). Der schwächste klar erkennbare Stern hat 7,5 mag. Andeutungsweise erkennt man sogar noch die Komponente E (11 mag).

Doppelt hält besser

Ein Planeten-Video umfasst häufig Dutzende von Gigabytes. Der Platzbedarf steigt mit der Zahl der Frames und der Größe des ROI. Vor allem auf Notebooks wird er schnell knapp. Dennoch empfehle ich, mindestens zwei Videos pro Objekt anzufertigen.

So haben Sie eines in Reserve, falls das andere durch ein technisches Problem unbrauchbar werden sollte. Das passiert. Falls Sie beim Fokussieren unsicher sein sollten, stellen Sie am besten bei jedem Video neu scharf. Das erhöht die Chance auf zumindest ein optimales Ergebnis.

Impaktsuche

Man kann Jupiter- und Saturnvideos auch verwenden, um nach Impaktblitzen in den Atmosphären dieser Planeten zu fahnden. Ich vermeide es deshalb, wechselnde Strukturen (Uhrzeiten etc.) ins Bild einzublenden. Näheres hier.

- Weiter zu: Bearbeitung der Aufnahmen

Alle Angaben ohne Gewähr